Por FREDERIK GOOSSENS - Diseñador UI experto @ TOPTAL (Traducido por YESICA DANDERFER)

Este artículo fue escrito originalmente en inglés

Cada vez más dispositivos controlados por voz, como Apple HomePod, Google Home, y Amazon Echo están asaltando el mercado. Las interfaces de usuario de voz están ayudando a mejorar todo tipo de experiencias de usuario diferentes, y algunos creen que la voz potenciará el 50% de todas las búsquedas para 2020.

La inteligencia artificial habilitada para voz puede ocuparse de casi cualquier cosa en un instante.

- “¿Qué sigue en mi calendario?”

- “Reserva un taxi a Oxford Street”.

- “¡Reprodúce Jazz en Spotify!”

Las cinco compañías de tecnología de los “Cinco Grandes” — Microsoft, Google, Amazon, Apple y Facebook — han desarrollado (o están actualmente desarrollando) asistentes de inteligencia artificial habilitados para voz. Siri, el asistente de inteligencia artificial para dispositivos Apple iOS y HomePod, está ayudando a más de 40 millones de usuarios por mes, y según ComScore, uno de cada diez hogares en los EE. UU. ya posee un altavoz inteligente hoy.

Ya sea que hablemos de VUI (Interfaces de usuario de voz) para aplicaciones móviles o para altavoces domésticos inteligentes, las interacciones de voz se están volviendo más comunes en la tecnología actual, especialmente porque la fatiga de la pantalla es una preocupación.

Echo Spot es el último altavoz inteligente de

Amazon que combina una VUI con una GUI, comparable a la Echo

Show.

Echo Spot es el último altavoz inteligente de

Amazon que combina una VUI con una GUI, comparable a la Echo

Show.

¿Qué pueden hacer los usuarios con los comandos de voz?

Alexa es la asistente de inteligencia artificial para dispositivos de Amazon habilitados para voz, como el altavoz inteligente Echo y la tableta Kindle Fire — Amazon actualmente lidera el camino con la tecnología de voz (en términos de ventas).

En la tienda de Alexa, algunas de las aplicaciones más modernas (llamadas “habilidades”) se centran en entretenimiento, traducción y noticias, aunque los usuarios también pueden realizar acciones como solicitar un paseo a través de la habilidad de Uber, reproducir música a través de la habilidad de Spotify o incluso pida una pizza a través de la habilidad del Domino.

Otro ejemplo interesante proviene del banco comercial Capital One, que introdujo una habilidad de Alexa en 2016 y fue el primer banco en hacerlo. Al agregar la habilidad de Capital One a través de Alexa, los clientes pueden verificar el saldo y las fechas de vencimiento e incluso liquidar su factura de tarjeta de crédito. PayPal llevó el concepto un paso más allá al permitir a los usuarios realizar pagos a través de Siri en iOS o Apple HomePod, y también hay una habilidad Alexa para PayPal que puede lograr esta.

Pero lo que las VUI pueden hacer, y para qué los usan realmente los usuarios, son dos cosas diferentes.

ComScore declaró que más de la mitad de los usuarios que poseen un altavoz inteligente usan su dispositivo para hacer preguntas generales, verificar el clima y transmitir música, seguido de cerca por la administración de su alarma, lista de tareas y calendario (tenga en cuenta que estas tareas son bastante básico por naturaleza).

Como puede ver, muchas de estas tareas implican hacer una pregunta (es decir, búsqueda por voz).

Uso de altavoces inteligentes en los EE. UU. De acuerdo con ComScore

Uso de altavoces inteligentes en los EE. UU. De acuerdo con ComScore

¿Qué buscan los usuarios con la búsqueda por voz?

La mayoría de las personas usa la búsqueda por voz mientras conduce, aunque cualquier situación en la que el usuario no pueda tocar una pantalla (por ejemplo, al cocinar o hacer ejercicio o al realizar múltiples tareas en el trabajo) ofrece una oportunidad para las interacciones de voz. Aquí está el desglose completo de HigherVisibility.

Las

actualizaciones de tráfico en tiempo real se vuelven mucho más fáciles mientras conduces gracias al Asistente de Google y Android Auto

Las

actualizaciones de tráfico en tiempo real se vuelven mucho más fáciles mientras conduces gracias al Asistente de Google y Android Auto

Realización de investigaciones de usuario para interfaces de usuario de voz.

Si bien es útil saber cómo los usuarios generalmente usan la voz, es importante que los diseñadores de UX realicen su propia investigación de usuario específica para la aplicación VUI que están usando. diseño.

Mapa del viaje del cliente

La investigación del usuario se trata de comprender las necesidades, los comportamientos y las motivaciones del usuario a través de la observación y la retroalimentación. Un mapa de recorrido del cliente que incluye voz como canal no solo puede ayudar a los investigadores de experiencia del usuario a identificar las necesidades de los usuarios en las diversas etapas de participación, sino que también puede ayúdelos a ver cómo y dónde la voz puede ser un método de interacción.

En el caso de que aún no se haya creado un mapa de viaje del cliente, el diseñador debe resaltar dónde las interacciones de voz se incluirán en el flujo del usuario (esto podría destacarse como una oportunidad, un canal o un punto de contacto). Si ya existe un mapa de viaje del cliente para el negocio, los diseñadores deberían ver si el flujo del usuario se puede mejorar con las interacciones de voz.

Por ejemplo, si los clientes siempre hacen una determinada pregunta a través de las redes sociales o el chat de soporte en vivo, entonces tal vez se trate de una conversación que se puede integrar en la aplicación de voz.

En resumen, el diseño debería resolver problemas. ¿Qué fricciones y frustraciones encuentran los usuarios durante un viaje del cliente?

VUI Análisis de la competencia

A través de análisis de la competencia, los diseñadores deberían tratar de averiguar si los competidores están implementando interacciones de voz y de qué manera. Las preguntas clave para hacer son:

- ¿Cuál es el caso de uso para su aplicación?

- ¿Qué comandos de voz usan?

- ¿Qué dicen los clientes en las revisiones de la aplicación y qué podemos aprender de esto?

Recopilación de requisitos

Para diseñar una aplicación de interfaz de usuario de voz, primero debemos definir los requisitos de los usuarios. Además de crear un mapa de viaje del cliente y realizar un análisis de la competencia (como se mencionó anteriormente), otras actividades de investigación como entrevistas y pruebas de usuario también puede ser útil.

Para el diseño de VUI, estos requisitos escritos son aún más importantes ya que abarcarán la mayoría de las especificaciones de diseño para los desarrolladores. El primer paso es capturar los diferentes escenarios antes de convertirlos en un flujo de diálogo conversacional entre el usuario y el asistente de voz.

Una historia de usuario de ejemplo para la aplicación de noticias podría ser:

“Como usuario, quiero que el asistente de voz lea las últimas noticias para que pueda recibir actualizaciones sobre lo que sucede sin tener que mirar mi pantalla”.

Con esta historia de usuario en mente, podemos diseñar un flujo de diálogo para ello.

La anatomía de un comando de voz

La anatomía de un comando de voz

Antes de que se pueda crear un flujo de diálogo, los diseñadores primero deben comprender la anatomía de un comando de voz. Al diseñar VUI, los diseñadores necesitan constantemente pensar sobre el objetivo de las interacciones de voz (es decir, ¿Qué intenta realizar el usuario en este escenario?).

El comando de voz de un usuario consta de tres factores clave: intención, expresión y ranura.

Analicemos la siguiente solicitud: “Reproduce música relajante en Spotify”.

Intención (el objetivo de la interacción de voz)

La intención representa el objetivo más amplio del comando de voz de un usuario, y esto puede ser una utilidad baja o interacción de alta utilidad.

Una interacción de alta utilidad se trata de realizar una tarea muy específica, como solicitar que se apaguen las luces de la sala de estar o que la temperatura de la ducha sea determinada. Diseñar estas solicitudes es sencillo ya que es muy claro lo que se espera del asistente de inteligencia artificial.

Las bajas solicitudes de utilidad son más vagas y difíciles de descifrar. Por ejemplo, si el usuario desea obtener más información acerca de Ámsterdam, primero deseamos comprobar si esto encaja o no en el alcance del servicio y luego hacerle más preguntas al usuario para comprender mejor la solicitud.

En el ejemplo dado, la intención es evidente: el usuario quiere escuchar música.

Expresión (Cómo el usuario pronuncia un comando)

Un enunciado refleja cómo el usuario frases su solicitud. En el ejemplo dado, sabemos que el usuario desea reproducir música en Spotify diciendo “Play me …”, pero esta no es la única forma en que un usuario puede realizar esta solicitud. Por ejemplo, el usuario también podría decir: “Quiero escuchar música …”.

Los diseñadores necesitan considerar cada variación de enunciado. Esto ayudará al motor de inteligencia artificial a reconocer la solicitud y vincularla a la acción o respuesta correcta.

Slots (las variables requeridas u opcionales)

A veces, un intento solo no es suficiente y se requiere más información del usuario para cumplir con la solicitud. Alexa llama a esto una “ranura”, y las máquinas tragamonedas son como los campos de formulario tradicionales en el sentido de que pueden ser opcionales o necesarios, dependiendo de lo que se necesita para completar la solicitud.

En nuestro caso, la ranura es “relajante”, pero como la solicitud aún puede completarse sin ella, esta ranura es opcional. Sin embargo, en el caso de que el usuario quiera reservar un taxi, la ranura sería el destino, y sería necesario. Las entradas opcionales sobrescriben cualquier valor predeterminado; por ejemplo, un usuario que solicita un taxi llega a las 4 p.m. sobrescribiría el valor predeterminado de “lo antes posible”.

Creación de prototipos de conversaciones VUI con flujos de diálogo

Los diseñadores de prototipos necesitan pensar como un guionista y fluye el diálogo de diseño para cada uno de estos requisitos. Un flujo de diálogo es un entregable que describe lo siguiente:

- Palabras clave que conducen a la interacción

- Ramas que representan el lugar donde la conversación podría llevar a

- Ejemplos de diálogos para el usuario y el asistente

Un flujo de diálogo es un script que ilustra la conversación de ida y vuelta entre el usuario y el asistente de voz. Un flujo de diálogo es como un prototipo, y se puede representar como una ilustración (como en el ejemplo a continuación), o hay aplicaciones de creación de prototipos que se pueden usar para crear flujos de diálogo.

Un

ejemplo de flujo de diálogo que ilustra la intención, el espacio y la conversación general

Un

ejemplo de flujo de diálogo que ilustra la intención, el espacio y la conversación general

Aplicaciones para creación de prototipos de VUI

Una vez que haya trazado el diálogo, estará listo para crear prototipos de las interacciones de voz con una aplicación. Algunas herramientas de creación de prototipos ya han ingresado al mercado; por ejemplo, Sayspringfacilita a los diseñadores la creación de un prototipo de trabajo para aplicaciones de Amazon y Google habilitadas para voz.

Sayspring

es una herramienta que hace que sea fácil prototipar una habilidad de Alexa o Google Home Action

Sayspring

es una herramienta que hace que sea fácil prototipar una habilidad de Alexa o Google Home Action

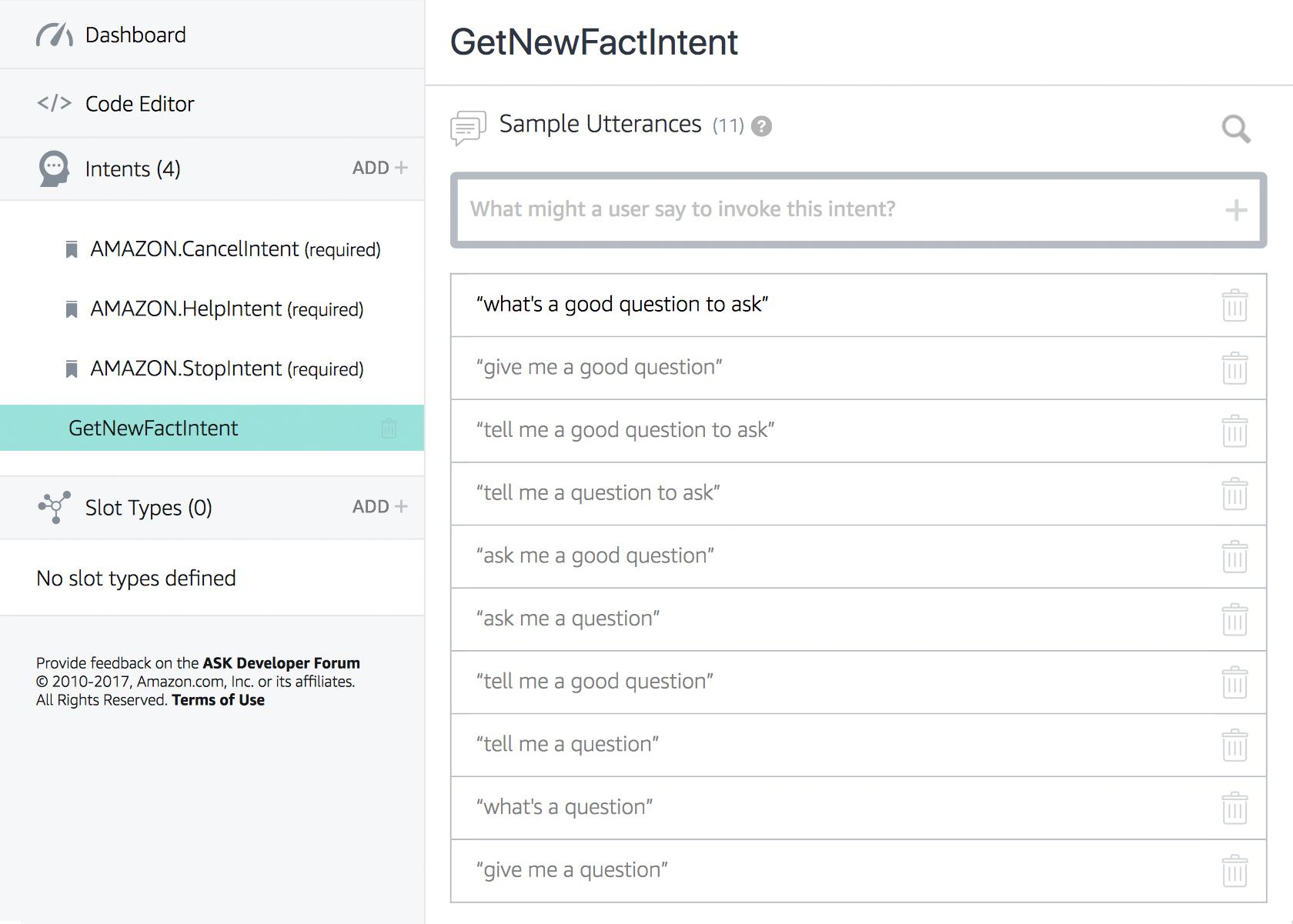

Amazon también ofrece su propio Alexa Skill Builder, lo que hace que sea más fácil para los diseñadores crear nuevas habilidades de Alexa. Google ofrece un SDK; sin embargo, esto está dirigido a los desarrolladores de Google Action. Apple aún no ha lanzado su herramienta competitiva, pero pronto lanzarán SiriKit.

Amazon's Alexa Skill Builder, where designers can prototype VUIs for Alexa-enabled devices.

Amazon's Alexa Skill Builder, where designers can prototype VUIs for Alexa-enabled devices.

UX Analytics para aplicaciones de voz

Una vez que haya desplegado una “habilidad” para Alexa (o una “acción” para Google), puede rastrear cómo se usa la aplicación con los análisis. Ambas compañías ofrecen una herramienta de análisis integrada; sin embargo, también puede integrar un servicio de terceros para análisis más elaborados (como voicelabs.co para Amazon Alexa, o dashbot.io) para el Asistente de Google). Algunas de las métricas clave a tener en cuenta son:

Métricas de interacción, como sesiones por usuario o mensajes por sesión

- Idiomas utilizados

- Flujos de comportamiento

- Mensajes, intenciones y emisiones

El Alexa Metrics

Dashboard de

Amazonmuestra métricas como sesiones, enunciados e intenciones.

El Alexa Metrics

Dashboard de

Amazonmuestra métricas como sesiones, enunciados e intenciones.

Consejos prácticos para el diseño de VUI

Mantenga la comunicación simple y conversacional

Al diseñar aplicaciones y sitios web móviles, los diseñadores deben pensar qué información es primaria y qué información es secundaria (es decir, no tan importante). Los usuarios no quieren sentirse sobrecargados, pero al mismo tiempo, necesitan suficiente información para completar su tarea.

Con la voz, los diseñadores tienen que ser aún más cuidadosos porque las palabras (y tal vez una GUI relativamente simple) son todo lo que hay para comunicarse. Esto lo hace especialmente difícil en el caso de transmitir información y datos complejos. Esto significa que menos palabras son mejores, y los diseñadoresdeben asegurarse de que la aplicación cumpla con el objetivo de los usuarios y se mantenga estrictamente conversacional.

Confirmar cuando se ha completado una tarea

Al diseñar un flujo de pago de eCommerce, una de las pantallas clave será la confirmación final. Esto le permite al cliente saber que la transacción se ha registrado correctamente.

El mismo concepto se aplica al diseño de VUI. Por ejemplo, si un usuario estaba en la sala de estar y le pedía a su asistente de voz que apagara las luces del baño, sin una confirmación, tendrían que caminar hacia la sala de estar y verificar, derrotando el objeto de una “mano”. “Aplicación VUI por completo.

En este escenario, una respuesta de “luces de baño apagadas” funcionará bien.

Crear una estrategia de error fuerte

Como diseñador de VUI, es importante tener una estrategia de error fuerte. Siempre diseña para el escenario donde el asistente no entiende o no escucha nada. Los análisis también se pueden usar para identificar giros incorrectos y malas interpretaciones, de modo que se pueda mejorar la estrategia de error.

Algunas de las preguntas clave que debe hacer al buscar diálogos alternativos:

- ¿Has identificado el objetivo de la interacción?

- ¿Puede la IA interpretar la información hablada por el usuario?

- ¿La IA requiere más información del usuario para cumplir con la solicitud?

- ¿Podemos entregar lo que el usuario ha pedido?

Agregar una capa adicional de seguridad

Google Assistant, Siri y Alexa ahora pueden reconocer voces individuales. Esto agrega una capa de seguridad similar a Face ID o Touch ID. El software de reconocimiento de voz mejora constantemente, y cada vez es más difícil imitar la voz; sin embargo, en este momento, puede no ser lo suficientemente seguro y una autenticación adicional puede ser requerido. Al trabajar con datos confidenciales, los diseñadores pueden necesitar incluir un paso de autenticación adicional, como huellas dactilares, contraseña o reconocimiento facial. Esto es especialmente cierto en el caso de los mensajes y pagos personales.

El

Asistente de voz Duer de Baidu se usa en varios restaurantes

de KFC y utiliza reconocimiento facial para hacer sugerencias de comidas según la edad o los pedidos anteriores.

El

Asistente de voz Duer de Baidu se usa en varios restaurantes

de KFC y utiliza reconocimiento facial para hacer sugerencias de comidas según la edad o los pedidos anteriores.

El amanecer de la revolución VUI

Los VUI llegaron para quedarse y se integrarán en más y más productos en los próximos años. Algunos predicen que no usaremos teclados en 10 años para interactuar con las computadoras.

Aún así, cuando pensamos en la “experiencia del usuario”, tendemos a pensar en lo que podemos ver y tocar. Como consecuencia, la voz como método de interacción rara vez se considera. Sin embargo, las voces y las imágenes no son mutuamente excluyentes cuando se diseñan experiencias de usuario; ambas agregan valor.

La investigación del usuario debe responder la pregunta de si la voz mejorará o no la UX y, teniendo en cuenta qué tan rápido está aumentando la cuota de mercado para dispositivos habilitados para voz, hacer esta investigación bien podría valer la pena el tiempo y aumentar significativamente el valor y la calidad de una aplicación.